Derniers Articles

AEO/GEO avec HubSpot : De la stratégie à l’exécution L’Apéro Parisien SEO & IA est de retour le 14 avril 2026 ! Universal Commerce Protocol (UCP) : Google annonce de nouvelles fonctionnalités GEO : où en est-on début 2026 ? Abondance organise un webinar de retours terrain Google prépare une option pour exclure son contenu des résultats IA dans Search Mistral frappe fort : nouveau modèle, alliance avec NVIDIA et agent de preuve formelle Audit technique SEO : les 3 analyses sous-cotées Goossips SEO : Désaveu de TLD & limites de crawl L’édition de mars 2026 de Réacteur est disponible ! Google lance des guides pratiques pour optimiser votre fiche Google Business ProfileLire l'article complet : Stratégie GEO : 5 optimisations EdgeSEO pour dompter les moteurs de réponse

Publié le 19/02/2026 à 13:17:34 par Abondance

Stratégie GEO : 5 optimisations EdgeSEO pour dompter les moteurs de réponse

Article sponsorisé par Fasterize

Si les systèmes évoluent de plus en plus vite, la capacité des équipes SEO à tester et déployer des optimisations reste quant à elle structurellement lente. Le time to market d'une roadmap SEO ne peut plus se faire uniquement sur 12 mois : il faut aussi pouvoir agir en temps réel.

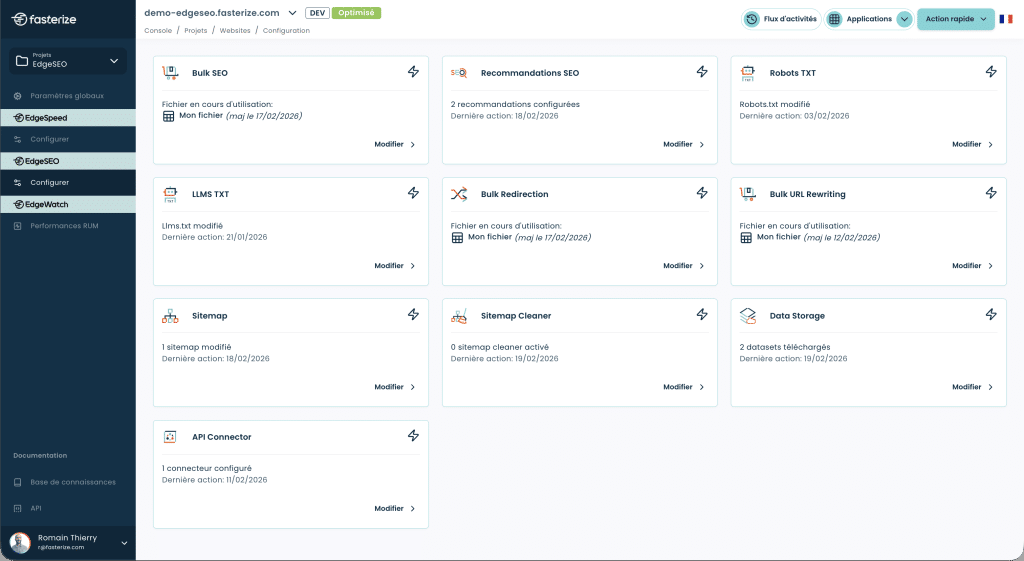

Fasterize redonne la main aux équipes SEO en leur permettant d'implémenter des expérimentations techniques de façon facile et rapide, sans mobiliser constamment les ressources de développement. Cette agilité nouvelle est d’autant plus importante dans un environnement où les moteurs de réponse IA (ChatGPT, Perplexity, Gemini) changent les règles de la visibilité en ligne.

LLMs.txt et bonnes pratiques

Le fichier robots.txt a longtemps été le standard universel pour contrôler l'accès des crawlers. Aujourd'hui, une nouvelle convention émerge : les fichiers /llms.txt et /llms-full.txt, conçus spécifiquement pour guider les agents d'intelligence artificielle. Ces fichiers permettent en théorie de définir des règles claires sur les parties du site accessibles aux LLMs, d'accorder ou refuser des permissions d'utilisation, et de communiquer des informations sur les droits d'usage du contenu.

La solution EdgeSEO de Fasterize offre la possibilité de servir ces fichiers de façon dynamique en fonction du User-Agent détecté, permettant ainsi une gestion plus granulaire de l'accès selon le bot qui interroge le site. Cette approche évite de créer des fichiers statiques multiples et permet d'adapter les règles en temps réel selon l'évolution des pratiques des différents LLMs.

À noter : à ce stade, les retours d’expérience indiquent que les LLMs prennent encore peu en compte ce type de fichier. Google a notamment précisé qu’il ne s’appuyait pas sur le fichier llms.txt, et le comportement des autres modèles peut varier selon les contextes d’usage.

Aujourd’hui, le fichier robots.txt reste le standard le plus largement reconnu pour orienter l’exploration des contenus. Cela dit, comme pour tout mécanisme déclaratif, il ne constitue pas une garantie absolue concernant l’utilisation éventuelle de contenus dans des jeux de données tiers (par exemple via des sources comme Common Crawl).

Mettre en place un fichier llms.txt est aujourd’hui une initiative encore largement exploratoire, sans risque pour votre site. Elle s’inscrit davantage dans une logique de test & learn que dans une stratégie de contrôle pleinement maîtrisée.

À ce stade, il s’agit surtout d’expérimenter, d’observer les éventuels signaux envoyés aux modèles, et de se positionner en anticipation des évolutions futures plutôt que d’attendre un impact immédiat ou garanti.

Le Markdown au service de la densité sémantique

Les agents IA adoptent massivement le Markdown comme format de référence, car il est plus léger, plus lisible et plus rapide à traiter pour les LLMs qu’un HTML parfois trop verbeux. Les développeurs utilisent des outils comme Crawl4AI et Firecrawl pour extraire du contenu web et l'alimenter aux LLMs, et des modèles comme ReaderLM-v2 sont entraînés spécifiquement pour cette transformation.

Le principe consiste donc à convertir le HTML en Markdown à la volée pour les agents IA uniquement. Cette transformation supprime le « bruit » technique (headers, footers, scripts, éléments de navigation) pour présenter au LLM un contenu pur, structuré et moins coûteux en tokens. Sur une page produit Amazon,...